目次

人工知能の歴史とChatGPTの登場

米国OpenAIが開発したチャット型QAサービスGPT-3.5によるChatGPTが2022年11月に発表されました。公開から5日間で利用者が100万人に上り、そして2023年1月には累計1億人が利用したとされています*1。

OpenAI のCEOが先日来日した際に、既に日本でも100万人以上のユーザがいるとコメントしています*2。

また、簡単な画像などに対応範囲を広げ、また発言に対する制限ルール(差別的発言をしないなど)を付加した「GPT-4」が2023年3月に公開されました(無償のTry ChatGPTではGPT-3.5)。

少し前まではこうしたチャット型のAIと言えばチャットボットで、形態素解析と人工無能(膨大な会話データベースを持つことで、入力された内容に対する自然な応答を事前に学習、蓄積させておく手法)*3によって、会話を成り立たせていました。

例えば「AIの学習方法の種類、各方法の特徴は?」と聞くと、AIに特化した人口無能は「学習方法の種類」は回答してくれますが、「各方法」という言葉を理解できない、ということになります。

しかし、ChatGPTでは同じ質問をした場合、「学習方法の種類」も「各方法の特徴」を理解し、質問によっては表形式で回答してくれるでしょう。AIの発展度合には驚くばかりです。

人工知能(AI)について、少し振り返ると、AIは1950年代から研究されはじめたと言われています。

探索と推論が中心だったのが1950年代の後半での第一次人工知能ブームとされていましたが、1980年代~1990年代には、知識表現を中心とした第二次人工知能ブーム、2000年代には機械学習を中心とした第三次人工知能ブームが来たとされ*4、機械学習(ML)やディープラーニング(DL)など現在の技術が生まれてきました。

そのような中で今回のChatGPTの登場を見ると、AIは指数関数的に進化していることが分かります。

ChatGPTとは

「GPT」とは「Generative Pre-trained Transformer」の略であり、それぞれの単語は「Generative: 生成型」、「Pretrained:教師あり学習(事前学習)」*5、Transformer*6はGoogle社が開発した自然言語処理のディープラーニングモデルを意味しています。

つまり、ChatGPTとは、LLM(大規模言語モデル)と呼ぶ自然言語処理モデルTransformerを使い、膨大に蓄積された教師あり学習データをもとに答えを生成し、自然な会話を通して回答をしてくれるAIです。

ChatGPTは毎日多くのメディアで使い方や、その凄さ、動向が紹介されていたり、4月10日には、OpenAIのCEOが岸田首相を訪問*7しており、話題に事欠きません。

ChatGPT利用時の注意点

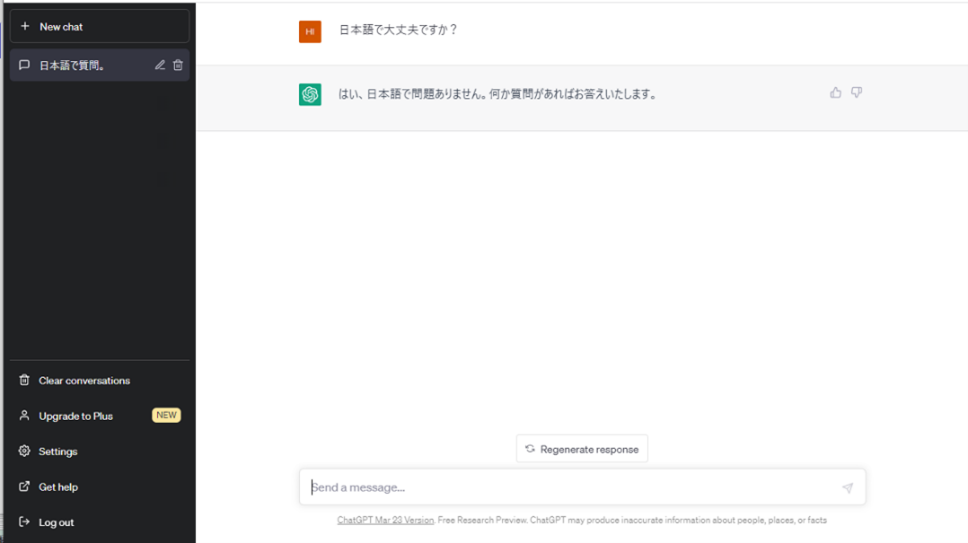

日本語でも大丈夫ですと回答するChatGPT

ChatGPTは、日本語でも回答をもらえることもあり、非常に便利です。また、普段の会話のような質問をすれば、数秒後には回答が返ってくるので、利用場面や方法を間違えなければ、重宝するツールになるでしょう(ただし、現時点では日本語の学習データが少ないため、回答間違いが少なくないなど課題が見られます。そのため、OpenAIのCEOが岸田首相に面会した際に、学習データの要求*8をしました。)。

しかし、活用するうえではいくつか注意事項があります。

Open AI社が公開しているPrivacy Policy(2023年4月7日更新)*9によれば、

同社が取得した個人情報(ChatGPT経由で取得されたもの含む)に関して

CCPA(カリフォルニア州消費者プライバシー法)に関する記載が見られ、また、EEA欧州経済領域(スイスを除くEFTA欧州自由貿易連合 3ヵ国+EU欧州連合 27ヵ国)の 30ヵ国とUKおよびスイスには具体的にアクションが定義されています。

それ以外の国は海外ユーザ(International users)として注意書きがあります。(日本もここに該当)しかし、日本の個人情報保護法を考えると、個人情報の定義など細かいところでカバーされていない部分がある可能性があるので、個人情報に関する記載はしない方が無難です。

また、同サイトのTerms of use(2023年3月14日更新)*10によれば、

ChatGPTから出力される回答の著作権に関して(筆者訳)

「3. Content」(コンテンツ)の 「(a) Your content」(お客様のコンテンツ)には、

「 お客様は、本規約を遵守すれば、販売や出版などの商業目的を含め、いかなる目的にもコンテンツを使用することができます。」

とあります。が、後続する文に

「OpenAIは、本サービスの提供および維持、適用される法律の遵守、および当社のポリシーの執行のためにコンテンツを使用することがあります。お客様は、コンテンツが適用される法律または本規約に違反していないことを確認することを含め、コンテンツについて責任を負います。」

とあるので、コンテンツ利用時の厳密な確認は、利用者側で行う必要があります。

入力した情報の利活用を拒否するオプトアウトに関して(筆者訳)

「3. Content」(コンテンツ)の 「(C) Use of Content to Improve Services」(サービス向上のためのコンテンツの利用)には、

「 当社は、当社のAPI以外のサービスから提供されたコンテンツ(以下「API以外のコンテンツ」)を、当社のサービスの開発および改善に役立てるために使用することがあります。

API以外のコンテンツがモデルのパフォーマンスを向上させるためにどのように使用されるかについては、こちらをご覧ください。お客様がご自身のNon-APIコンテンツのサービス向上のための利用を希望されない場合は、このフォーム*11にご記入いただくことでオプトアウトできます。」

という記載があり、入力の度に申請をすれば、上記「こちら」で定める方法での利活用を拒否することができるそうです。

上記の「こちら*12」の抜粋には、(筆者訳)

「 私たちは、モデルのパフォーマンスを向上させるために使用しようとするデータから、個人を特定できる情報を削除します。また、モデルの性能を向上させるために使用するデータは、お客様ごとに少量のサンプリングにとどめています。私たちは、お客様のデータを保護するために、適切な技術的およびプロセス的コントロールを使用するよう細心の注意を払っています。」

と記述されていますが、後述する脅威のリスクを踏まえると、なにか利活用されては困る情報については入力しない方が無難でしょう。

内容の正確性に関して(筆者訳)

「3. Content」(コンテンツ)の 「(d) Accuracy」(精度)には、

「 AI・機械学習の確率的な性質を考慮すると、当社のサービスを使用すると、状況によっては、実在の人物、場所、または事実を正確に反映しない不正確な出力が生じる場合があります。お客様は、出力に対する人間のレビューを使用することを含め、お客様のユースケースに適した方法で、あらゆる出力の正確性を評価する必要があります。」

とありますので、精度に関しては保証しているわけではないので、最終的には人間が倫理的なことを含めて確認する必要があります。

ChatGPTとサイバー脅威リスク

ChatGPTでは利用する際に、以下のリスクについて注意する必要があります。

情報漏えいリスク(「➡ 個人情報に関して」および「➡ 情報漏えいを防ぐためのオプトアウトに関して」参照)

前述のオプトアウトと関連して、有償のAPIを利用すれば、入力した情報が再利用されることはありません。しかし、無償の場合は、オプトアウトを申請しない限りは、情報の利活用がされる状態ですので、利用の際には第三者に見られると困る情報は入力しないことが必要です。

プロンプト・インジェクションのリスク(「★ 情報漏えいリスク」に関連し)

プロンプトを悪用してChatGPTの回答に他のユーザが入力した情報を盗むプロンプト・インジェクションを行うサイバー攻撃のリスクもあります。これは、AIが想定していない、悪意のある指示をAIにすることで不正に情報を入手する方法です。

ChatGPTが問いかけるプロンプトにて、利用者とChatGPTは会話をします。そして入力する内容によってはプロンプト・インジェクションによって第三者から情報を取得されてしまう可能性もあるでしょう。

サイバーセキュリティへのAI活用

サイバーセキュリティにおいてAIは、様々な条件やデータから最適なセキュリティ設定を提案したり、通常と違うアクセスなどを発見したり、という点で活用されています。

例えば、サイバーセキュリティでは既にAIが実装されている『操作や設定時の提案』は有効であり、非常に役立つ方法だと思います。

また、新たにAI機能が提供されることで、当社が扱っているサイバー脅威インテリジェンス情報のRecorded Futureのように、既に発生したサイバー脅威の情報を、他の情報と迅速に紐づける*13ことでより一層多くの、かつ多様な脅威を推測するインテリジェンスを誤検知少なくしつつサイバーセキュリティ対策に活用することが、より有効な対策には役立つと思います。

AIと同様に、ChatGPTもサイバーセキュリティへ活用されるのもそう遠くはないと思います。

OpenAI のUsage Policies(使用ポリシー)では*14、マルウェアの生成や攻撃を仕掛けるプログラムの開発への利用を禁じています。裏を返すと、悪意を持った人が、ChatGPTを使ってマルウェアの作成や、新たな攻撃をしかけるプログラム開発ができてしまう危険性があるということです。

リスクを避けつつ、上手く活用しましょう

ChatGPTについては、組織や企業においては利用を制限したり、イタリアのように、国全体で利用に制限を設けていることもあります*15。もちろん、利用を促進している企業もあります*16。

ChatGPTは言葉や事柄を調べる、あるいは翻訳に使うといった場面で非常に便利であり、業務の効率化に大きく貢献すると思います。しかし、入力したデータは、ChatGPTの更なる学習のために利用されるため、少なくとも取引先情報などをはじめとする重要な情報については入力するべきではないでしょう。

リスクを理解しつつ、上手く活用しましょう。

出典 (参考文献一覧)

※1 ZDNET|ChatGPT just became the fastest-growing 'app' of all time(参考日:2023-4-20)

※2 ITmedia NEWS|OpenAIのアルトマンCEO、「日本のChatGPTユーザーは100万人超」(参考日:2023-04-20)

※3 Wikipedia|人工無能(参考日:2023-04-20)

※4 総務省|平成28年版 情報通信白書|人工知能(AI)研究の歴史(参考日:2023-04-20)

※5 Wikipedia|教師あり学習(参考日:2023-04-20)

※6 Wikipedia|Transformer (機械学習モデル) (参考日:2023-04-20)

※7 NHK|「ChatGPT」開発企業のアルトマンCEO 岸田首相と面会(参考日:2023-04-20)

※8 ギズモード・ジャパン|ChatGPTのOpenAI社、日本に7つの提案。本気で普及を狙う(参考日:2023-04-20)

※9 OpenAI|Privacy policy(参考日:2023-04-20)

※10 OpenAI|Terms of use(参考日:2023-04-20)

※11 OpenAI Help Center|How your data is used to improve model performance(参考日:2023-04-20)

※12 Google Docs(参考日:2023-04-20)

※13 Recorded Future|Introducing Recorded Future AI: AI-driven intelligence to elevate your security defenses(参考日:2023-04-20)

※14 OpenAI|Usage policies(参考日:2023-04-20)

※15 朝日新聞デジタル|ChatGPTの禁止解除、必要な措置明らかに イタリア当局が発表(参考日:2023-04-20)

Yahoo!ニュース|JPモルガン・チェースも従業員によるChatGPTの利用を制限(参考日:2023-04-20)

※16 Business Insider Japan|パナソニックコネクトの「社内ChatGPT」全社導入。1カ月使い倒して見えてきた成果とは(参考日:2023-04-20)